OpenAI出手了!为了不让超级智能失控,首席科学家Ilya Sutskever和Jan Leike将一起领导团队在未来4年投入20%算力,处理超智能AI对齐问题。

超级AI智能会杀死所有人!

Sam Altman曾多次揭露表态对AI未来的忧虑,乃至自己都夜不能寐。

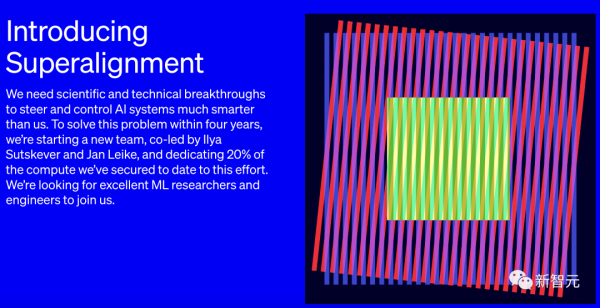

现在,OpenAI组成了一个团队,试图用20%算力,在未来4年处理「超级智能对齐问题」。

最新团队将由联合创始人兼首席科学家Ilya Sutskever和Jan Leike一起领导。

博客开篇,短短几行,遍论述了OpenAI对超级智能降临时刻的预判,以及具有「毁天灭地」才能的重度忧虑。

超级智能将是人类创造的最具影响力的技能,能够协助咱们处理国际上许多最重要的问题。但超级智能的巨大力量也或许十分风险,并或许导致人类丧失权利,乃至导致人类灭绝。

虽然有超级智能现在看来还很悠远,咱们相信这或许在十年内完结。

接下来4年,OpenAI要做的,便是防止超级智能杀死所有人类。

四年处理超级AI对齐问题

而Altman以为,想要管理这些风险,彻底处理对齐问题,就必须成立新的管理机构。

他表明,现在还没有一个像样的处理方案来引导或操控潜在的超级AI。

当前的技能,都依赖于人类的监督,比如依据人类反应进行的强化学习(RLHF)等等。

但纯靠人力来监督比咱们聪明得多的AI体系,总有一天会费劲又吃力。而现在的对齐技能又无法扩展到超级智能,所以对新技能突破的需要就提上了日程。

Altman在今天还发起了「英雄榜」。

OpenAI的方针,便是树立一个大致拥有人类水平的主动对齐研讨员,然后用大量核算扩展研讨作业,迭代调整超级智能。

为了创立第一个「主动对齐研讨员」,本质上讲创立一个AI,OpenAI分三步走。

第一,开发一种可扩展的练习方法;

第二,验证生成的模型;

第三,对整个对齐管道进行压力测验。

研讨人员使用AI体系来协助评估其它AI体系(可扩展的监督),同时研讨人员还期望了解并操控他们的模型是怎么将监督推广到人类研讨员无法监督的使命上去的(有点绕嘴)。

之后,研讨人员为了验证体系的一致性,主动搜索了有问题的行为,以及存在问题的内部结构。

最后能够经过找到一个未对齐的模型来测验整个流程,承认开发的框架能够检测到各种不同的未对齐类型(称为对抗性测验)。

OpenAI的研讨人员估计,随着对这个问题的研讨越来越深化,研讨重点也会发生变化,乃至还或许会有新的研讨范畴呈现。

全新团队

为此,OpenAI正式宣布,组成一个由尖端机器学习研讨人员和工程师组成的团队——「Superalignment」。

在接下来的四年里,OpenAI将投入到现在为止获得的核算资源中的20%,用于处理超级AI的对齐问题。

在这个过程中,估计将会有许多团队参与进来,从开发新方法到将其扩展至实际应用。

OpenAI表明,自己的方针是在四年内处理超级智能对齐的中心技能应战。

虽然听起来很大,完结起来也不一定100%成功,但OpenAI仍是以为只需集多方努力,仍是能够处理的。

Ilya Sutskever作为OpenAI的联合创始人兼首席科学家,已经把这个方针当作其中心研讨重点,并将与Jan Leike——对齐项目负责人,一起领导该团队。

团队成员包含此前负责对齐作业的研讨人员和工程师,乃至还有其他团队的研讨人员,可谓阵容庞大。

LeCun所言「狗级」AI,真会十年翻身?

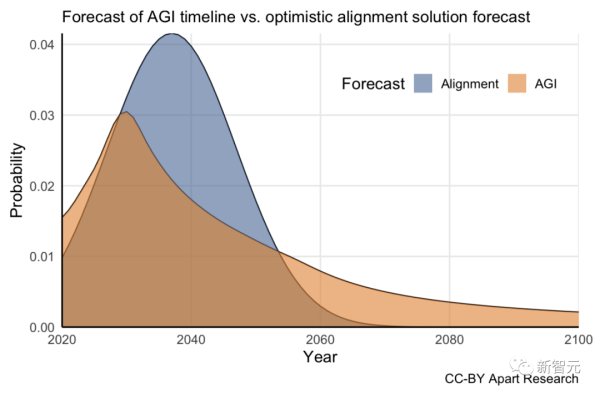

能够说,OpenAI对超级智能AI体系的将在十年内诞生,是一个十分斗胆的猜测。

首要,就拿ChatGPT来说,没有人承认它是一个能够进行人类思想的人工智能。

与之相反,ChatGPT作为一个类似于主动完结的大型言语模型,能够从头创立类似人类的反应,但没有完全了解单词背后的意义。

因而,有时候它会编造明显过错,或无法了解底子逻辑的答案。

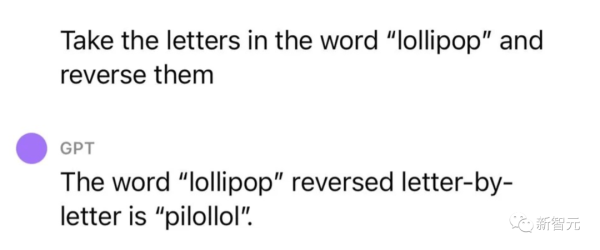

前段时刻,吴恩达在新开的课程中指出,ChatGPT不会回转单词直接登上Reddit热榜。

比如,让它回转lollipop这个词,输出的是pilollol,简直是完全紊乱的。

究其原因,首要仍是大模型选用token来处理文本,这样好处是能降低内存和时刻复杂度。

可是,将单词token化,明显存在一个致命的问题,那便是模型很难学习到有意义的输入,也就能了解为什么ChatGPT不能了解单词意义的原因了。

当让它处理单词回转使命时,模型或许便是把每个token回转过来,由此才出丑。

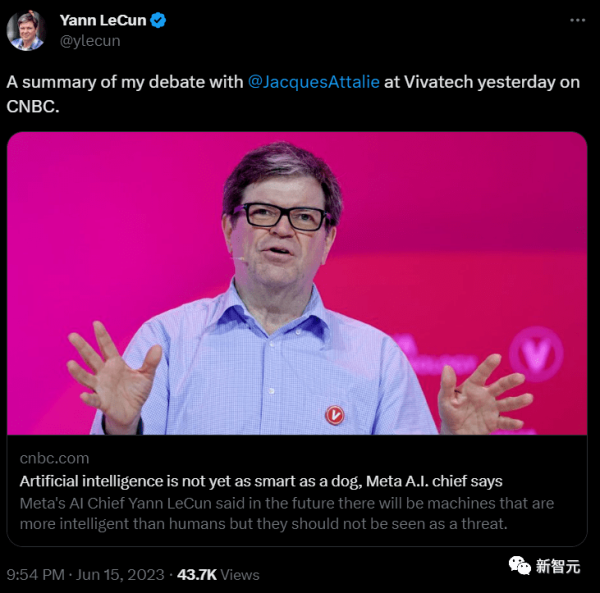

抛开ChatGPT,再广泛地来讲,一直以来图灵奖的主Yann LeCun都把当前人工智能称作,连猫狗都不如的AI。

一句话总结,「论聪明程度,ChatGPT或许连条狗都不如。」

LeCun表明,当前的AI体系,哪怕是ChatGPT,底子就不具备人类的智能水平。

在他看来,不用太过严重,现在的AI智能水平远远没到咱们该忧虑的境地。

现在的生成式AI模型都是在LLM上练习的,而这种只承受言语练习的模型聪明不到哪去。这些模型的性能十分有限,它们对实际国际没有任何了解。

由此,在一些人看来,OpenAI猜测超级智能AI行将到来好像很奇怪。

尽管如此,他们仍是期望做好预备,能够以先发制人的优势,将AI灭绝人类的主意扼杀在摇篮中。

网友答疑

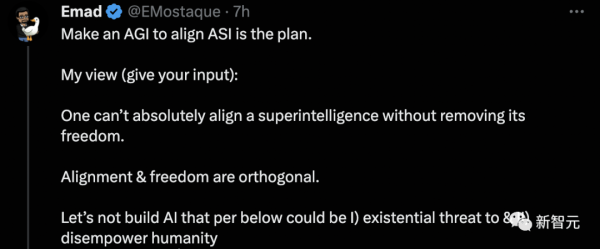

Stability AI的CEO表明,使AGI与ASI保持一致是咱们的方案。

我的观点(提出你的意见):咱们不或许在没有拿走自在的情况下绝对地对齐一个超级智能体。对齐和自在是正交的。咱们不要建造那些或许会对人类形成 I)生计要挟和 II)剥夺人类权利的人工智能。

依据OpenAI博客介绍,未来要投入20%算力去做这件事,却遭到网友的质疑。

现在是时候有人考虑超级智能的安全问题了。但让咱们实际一点,20%的核算量真的能处理问题吗?关于这样一个巨大的问题,好像只是杯水车薪。

OpenAI的对齐团队领导人Jan Leike解释道,

20%的核算量不是一个小数目,我对OpenAI乐意以这种规划分配资源感到十分形象深刻。

这是有史以来对对齐的最大出资,它或许比人类到现在为止在对齐研讨上的总花费还要多。

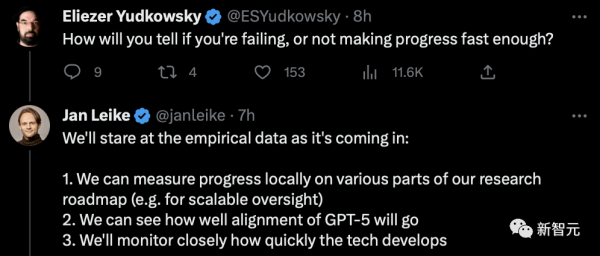

OpenAI将用4年的时刻去完结这项使命,怎么判别是否失利了,或许发展不够快?

咱们会关注行将到来的实证数据:

1. 咱们能够在本地衡量研讨路线图的各部分发展(例如,可扩展的监督)

2. 咱们能够看到GPT-5的对齐作用怎么

3. 咱们将密切关注技能的发展速度

其实大多数人仍是很想知道,OpenAI是不是在真实处理对齐研讨之前,不会再研发超级AI了。

其实,Jan Leike的话中,早已泄漏出了GPT-5正在研发中。

许多人仍是比较支持OpenAI这么做的。

网友表明,期望机器的可解释性是战略的一部分,ASI不该该是一个黑盒子。假如咱们有一天在不了解它是怎么作业的情况下树立一个ASI,咱们将有很大的麻烦。